第4回:Import最適化:SAPマイグレーションのダウンタイム変動要素

公開日: 2010.01.23 更新日: 2026.05.18

リアルテックジャパン株式会社 技術チーム- ホーム

- ブログ

- SAPパフォーマンス最適化

- 第4回:Import最適化:SAPマイグレーションのダウンタイム変動要素

RELATED POST関連記事

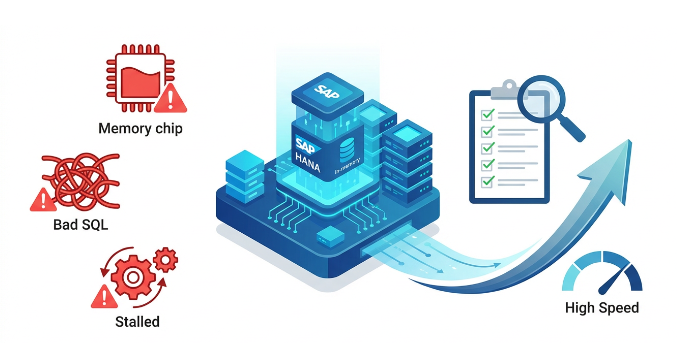

- SAP HANAのパフォーマンスが出ない?高速化を実現する5つのチェックリスト

- システム移行時の移送高速化とリスク低減を実現する|REALTECH SmartChange Transport Management

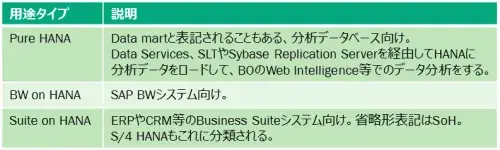

- SAPユーザ必見!? SAP HANAとは

- SAPのパフォーマンスに問題が出てきたら?その分析のポイント

- SAP HANA のメモリーサイジングとサーバ選定

- HANA Voraの基本機能を読み解く~インメモリクエリエンジン他~

- DB HANA化パフォーマンス検証結果とそのメリット(後編)

- DB HANA化パフォーマンス検証結果とそのメリット(前編)

- S/4HANAの勘所:HANA Viewを使った分析高速化

- [TIPS] ST04_グラフに表示する項目・期間の指定方法

- SAP基幹システムがSQL Server SSD Applianceでサクサクに!

- 第8回 最近のMigration事情 - ネットワーク -

- 第7回 最近のMigration事情 - SQLServer の圧縮 -

- 第6回 最近のMigration事情 - R3ta -

- 第5回:補足処理最適化:SAPマイグレーションのダウンタイム変動要素

- 第3回:Export最適化:SAPマイグレーションのダウンタイム変動要素

- 第2回:不要な処理:SAPマイグレーションのダウンタイム変動要素

- 第1回:序章:SAPマイグレーションのダウンタイム変動要素

- 第3回:チューニング編:SAPエンハンスメントパッケージ適用の実際

- 第3回:SPDD編:SAPアップグレードのダウンタイム変動要素

RECENT POST 最新記事

RANKING人気記事ランキング

SEARCHブログ内検索

目次