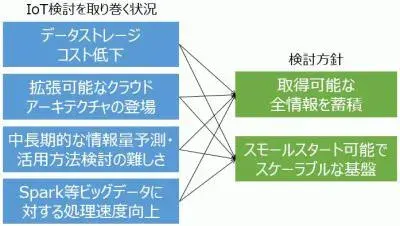

2/6 収集・蓄積:S/4HANA, Vora & Spark on AWSから生まれる価値

公開日: 2016.07.29 更新日: 2026.04.14

リアルテックジャパン株式会社RELATED POST関連記事

- 【祝SAP Tech JAM】NUTANIX環境の実機が見られます!

- 【手順詳細】Azureサブスクリプションを移行してみた

- 【SCO・SMA・Azure Automation】Microsoft自動化ツールを整理してみた

- SCOM+Azure課金APIを使って課金ダッシュボードを作ってみた

- EA Azureサブスクリプション設計:コスト管理ツール

- EA Azureサブスクリプション設計:弊社のコスト最適化事例

- EA Azureサブスクリプション設計:管理体系と使いこなし

- EA Azureサブスクリプション設計:Azureのサブスクリプションとは

- Go Azure 2015:全セッション動画公開されました。

- 圧巻のMicrosoft TechEd Europe 2014 セッション一覧(直LINK付)

- ゼロから始める Azure -自社サイト間VPN(S2S)接続

- 【祝】AzCopy 2.5リリース

- 2016年1月からInternet ExplorerのMSサポートは最新版のみ

- 【SAP監視無償アプリ】複数SAPシステムを一画面で監視

- 【速報】SAP on Microsoft Azure 稼働認定OK!

- [TIPS]Windows AzureにPoint to Site(P2S) VPN接続してみた

- Windows Azureの日本データセンターがオープン

- Windows AzureのCDP( Cloud Design Patterns )と Symbol/Icon Set

- 【第3回】SAPUI5とSAP Netweaver Gatewayによるマッシュアップ開発入門(SAPUI5編)

- 【第2回】SAPUI5とSAP NetWeaver Gatewayによるマッシュアップ開発入門(Gateway構築編)

- 【AWS EC2】Public Cloud(IaaS)で初のSDベンチマーク結果公開

- Amazonクラウド:AWS EC2東京リージョンのネットワーク速度測定結果

- SAP環境でSQL Server 2008での2次インデックスの圧縮がサポートに!

- AWSでSAPを稼働させるメリットとは? 移行時のポイントと一緒に解説

- Nutanix 拡張性:SAP on Nutanix

- Nutanix 監視:SAP on Nutanix

- Nutanix バックアップ:SAP on Nutanix

- Nutanix ストレージ:SAP on Nutanix

- Nutanix Web管理画面(Prism):SAP on Nutanix

- 【技術白書公開】SAP on Nutanix 基本性能検証結果報告書

- NUTANIXの実力:AWS上にSAP仮想環境をバックアップ【動画公開】

- ハイパーコンバージドインフラNUTANIXをSAPで使ってみた。【動画公開】

- ハイパーコンバージドインフラ(HCI)とSAPの繋がり

- ハイパーコンバージドインフラ(HCI)登場に至った歴史

- サーバ仮想化の次の一手:ハイパーコンバージドインフラ(HCI)

- 【速報】Azure上でSAP on Oracle がサポートに!

- 新しいAzureの自習書が公開されています。

- 【SAP on Azure】東京:ERPパフォーマンス測定結果

- SAP on AWS : AWS Cloud Storage Dayで弊社一部登壇させて頂きました。

- 【動画公開】「大規模SAPシステムをAWSに移行せよ」ドキュメンタリー

- 【EXPO 2013春】TechTargetで「SAP on AWS」出展内容が取り上げられました

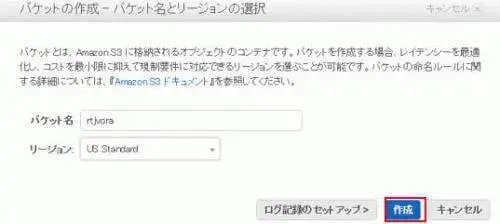

- 【EXPO 2013春】SAP本番機をAWS上に移行するには?:大容量データをアップロードする手段

- 【EXPO 2013春】クラウドWatchで「SAP on AWS」出展内容が取り上げられました

- 【祝SAP Tech JAM】HANAのインフラ基盤と運用監視とノウハウ

- 【祝SAP Forum】S/4HANA, Vora & Spark on AWS

- 3/6 抽出・統合:S/4HANA, Vora & Spark on AWSから生まれる価値

- 6/6 SNS連携:S/4HANA, Vora & Spark on AWSから生まれる価値

- 5/6 見える化:S/4HANA, Vora & Spark on AWSから生まれる価値

- 4/6 機械学習:S/4HANA, Vora & Spark on AWSから生まれる価値

- 1/6 概要編:S/4HANA, Vora & Spark on AWSから生まれる価値

- 【デモ動画】S/4HANAの可用性向上:HANA System Replication + SLES HAE

- SAPクラウド基盤への移行手順|2027年問題に向けた最適な戦略

- SAPをAzureに移行する方法とポイント

- S/4HANA拡張のカギはSAP BTP連携にあり!成功事例と導入のポイント

RECENT POST 最新記事

RANKING人気記事ランキング

SEARCHブログ内検索

目次